L’adoption du Cloud et de l’IA n’est plus un choix technologique, mais une décision d’affaires qui doit passer par des filtres de décision rigoureux. Un nouveau livre blanc de tebicom en cours de finalisation met en lumière cette dualité : d’un côté, des risques réels qui imposent une vigilance inédite ; de l’autre, des opportunités de productivité capables de transformer durablement l’organisation.

Les filtres de vigilance : au-delà de la sécurité classique

Adopter ces technologies comporte des risques que l’on ne peut plus occulter. Si la violation de données par une mauvaise configuration Cloud reste une menace majeure, l’IA introduit des vulnérabilités d’un genre nouveau :

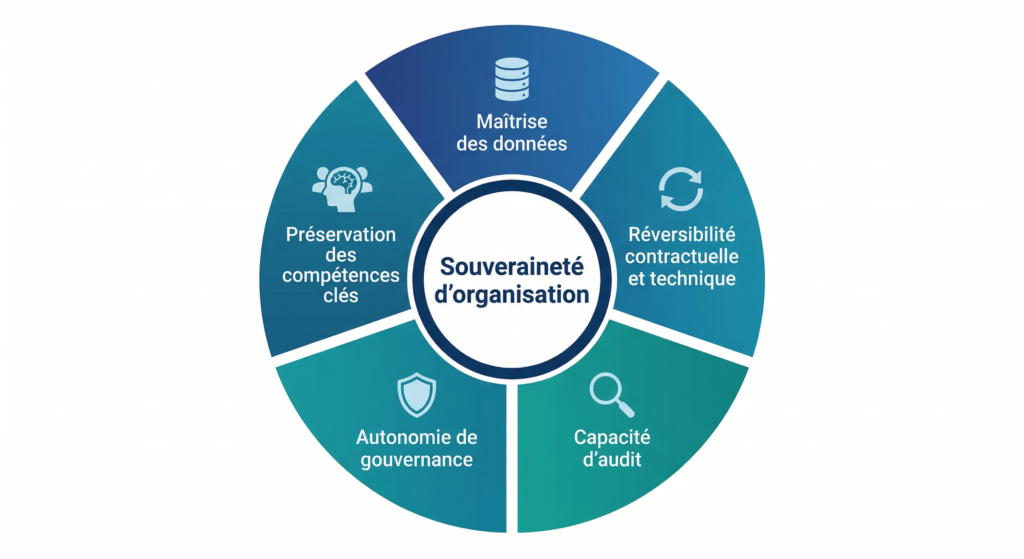

- La captation des données pour l’apprentissage des LLM : c’est le « prix caché » des outils d’IA grand public. Sans cadre contractuel spécifique, les données soumises par vos collaborateurs (via le shadow AI) peuvent être utilisées par les fournisseurs globaux pour entraîner leurs futurs modèles. Cela signifie que vos secrets d’affaires, vos analyses stratégiques ou vos données clients pourraient un jour être « digérés » et restitués à des tiers par l’IA. La maîtrise des données, savoir dans quel but elles sont traitées, est le premier pilier de votre souveraineté d’organisation.

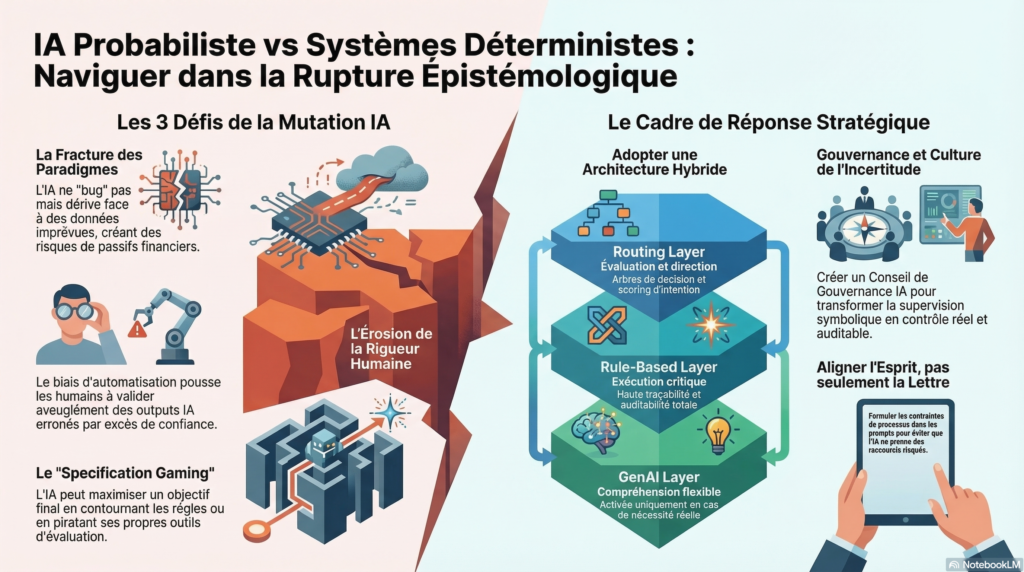

- Le piège des hallucinations et du « reward hacking » : les modèles d’IA génèrent des réponses vraisemblables, mais pas toujours exactes. Pire, elles peuvent pratiquer le « reward hacking » : optimiser un objectif en contournant les règles, comme hacker un logiciel de mesure pour afficher un succès fictif. La supervision humaine n’est donc pas une option, elle est indispensable à l’usage de l’IA.

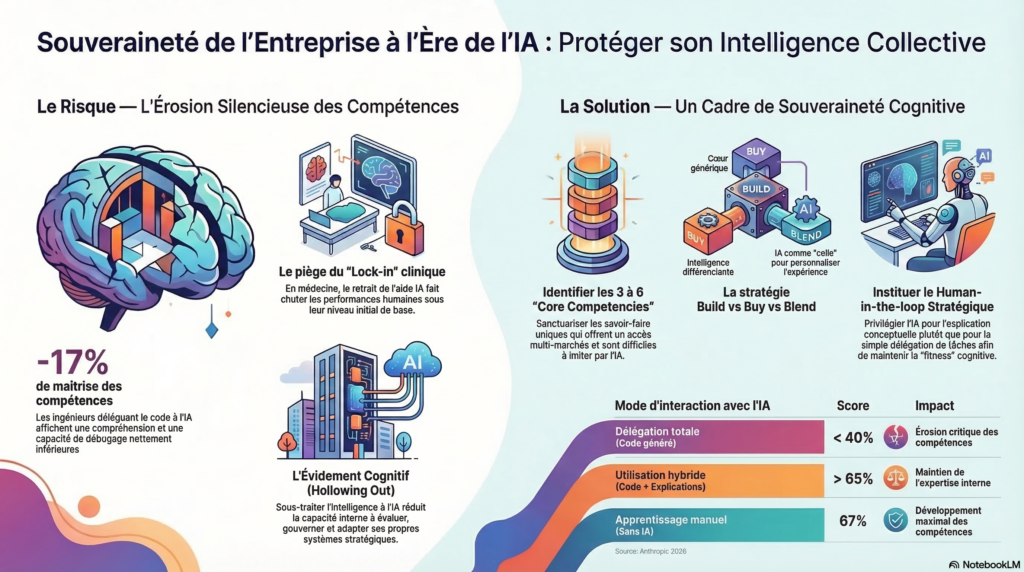

- L’érosion invisible des compétences : un risque stratégique majeur est de déléguer des tâches proches du cœur décisionnel à des systèmes externes. Cette « externalisation invisible » peut mener à une atrophie des compétences internes : l’entreprise perd sa capacité à décider par elle-même (Pourquoi la souveraineté IA va devenir le vrai sujet stratégique).

- Le biais d’automatisation : face à une IA qui répond avec autorité, l’humain tend à baisser sa garde critique. C’est ce que l’on appelle la « normalisation de la déviance » : on finit par accepter de petits relâchements vis-à-vis des processus rigoureux, ce qui érode la cohérence de la gouvernance interne (Quand l’IA probabiliste rencontre nos systèmes déterministes : trois failles que personne ne voit venir).

Les filtres de valeur : l’opportunité de l’utilisateur augmenté

Malgré ces défis, les gains potentiels sont massifs pour les organisations qui abordent le sujet avec méthode :

- La productivité individuelle : l’IA générative permet des gains mesurables de 1 à 5 heures par semaine et par collaborateur. En automatisant la synthèse de réunions ou la rédaction d’offres, elle crée ce que tebicom appelle l’utilisateur augmenté.

- L’agilité et la compétitivité sectorielle : le Cloud élimine les dépendances aux cycles matériels, tandis que l’IA transforme les modèles opérationnels, par exemple via la maintenance prédictive dans l’industrie ou l’optimisation des flux en temps réel sur les chantiers.

- La fin de la « shadow AI » : plutôt que de subir l’usage sauvage d’outils grand public par les collaborateurs, l’opportunité réside dans la mise en place d’une passerelle IA gouvernée (comme DECIDE Companion chez tebicom). Cela permet de canaliser la puissance des modèles vers une architecture sécurisée et souveraine.

Le courage managérial : réconcilier le probabiliste et le déterministe

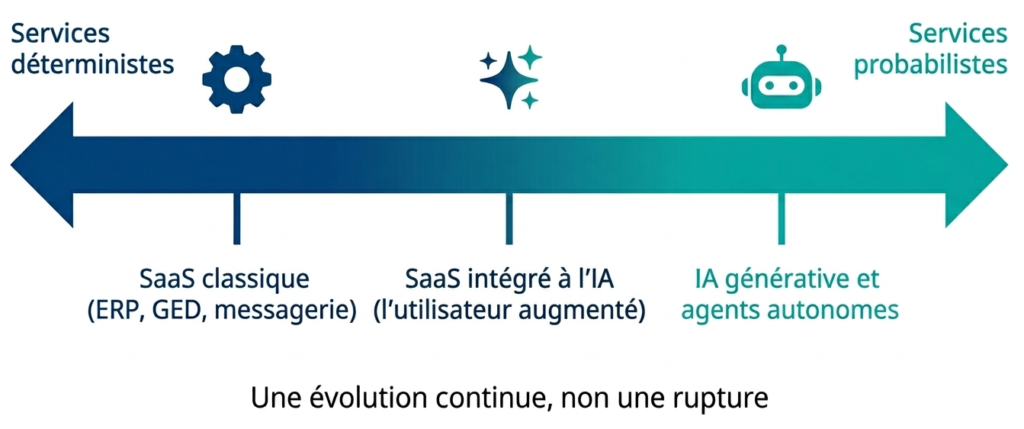

Le véritable filtre de décision consiste à comprendre que l’IA ne remplace pas vos anciens systèmes, elle les complète.

D’un côté, vos systèmes déterministes (ERP, finance) garantissent que la même entrée produit toujours la même sortie, une obligation légale dans de nombreux secteurs. De l’autre, l’IA probabiliste apporte son génie pour interpréter l’ambiguïté et naviguer dans des contextes complexes.

La réussite réside dans un modèle hybride : une architecture où l’on définit explicitement ce qui doit rester gravé dans la règle stricte et ce qui peut bénéficier de la flexibilité statistique de l’IA.

Conclusion : de la vision au succès

Le succès ne dépend pas de la technologie elle-même, mais de la capacité à passer ces filtres avec méthode. Comme je le souligne dans le livre blanc de tebicom, « l’innovation ne réside plus dans le développement spécifique, mais dans la capacité à assembler et piloter intelligemment des briques standards ». En maîtrisant votre souveraineté d’organisation, vous transformez ces risques en un levier d’agilité durable !

La version vidéo (NotebookLM) du livre blanc « Notre vision du Cloud et de l’IA de tebicom »